Yapay zekanın yanıltıcı içerikler üretme potansiyeli ve bu içeriklerle mücadele yöntemleri, günümüzün önemli tartışma konularındandır.

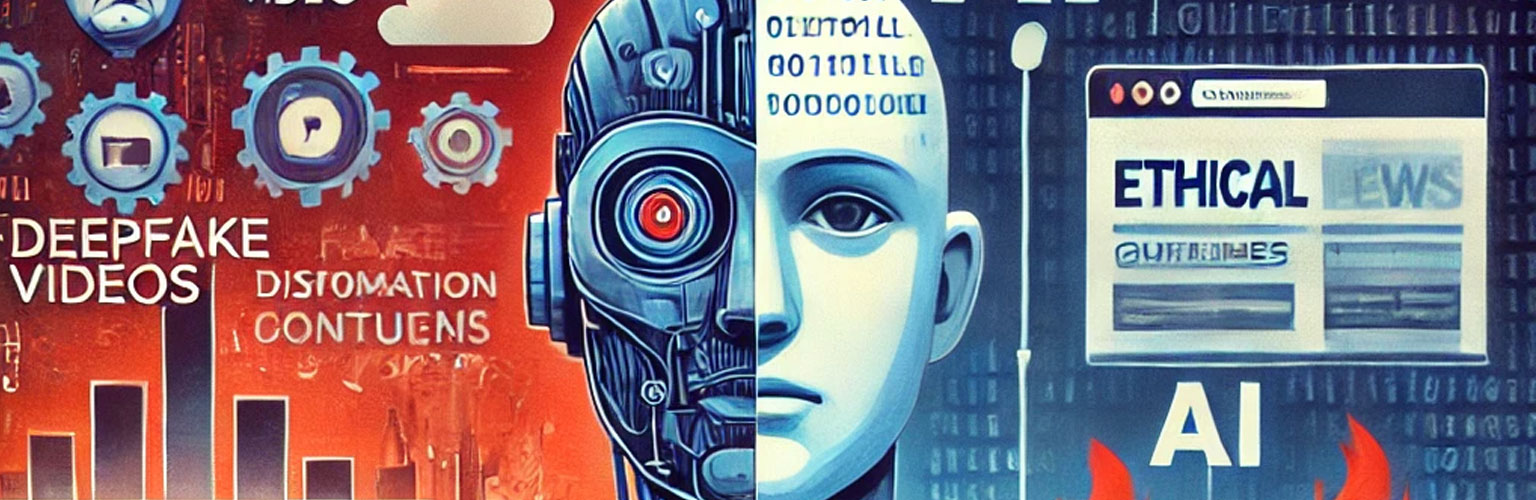

"Yapay Zeka Tarafından Üretilen Yanıltıcı İçerikler", "AI'nin Etik Kullanımı", "Yapay Zeka ve Deepfake Teknolojileri" ve "Yapay Zeka ile Mücadelede Yeni Yaklaşımlar" gibi çalışmalar, yapay zekanın nasıl yanıltıcı içerikler üretebileceğini ve bu içeriklerle nasıl mücadele edileceğini analiz eder. Ayrıca, yapay zekanın toplumsal ve etik etkilerini değerlendirerek, bu teknolojilerin sorumlu bir şekilde nasıl yönetilebileceğine dair önerilerde bulunur. Yapay zeka ve dijital dezenformasyon konularında uzmanlaşmış araştırmacıları, bu kritik alanda bilgi ve çözüm önerilerini paylaşmaya davet ediyoruz. Yapay zeka destekli dezenformasyonla mücadele, bilgi güvenliği ve etik değerlere uygun kullanımın sağlanması açısından büyük önem taşır.

Yapay zeka tarafından üretilen yanıltıcı içerikler, toplumun bilgiye erişim şekillerini ciddi şekilde etkileyebilir. Örneğin, derin sahte (deepfake) videolar, politikacıların konuşmalarını veya eylemlerini manipüle ederek kamuoyunu yanlış bilgilendirebilir. 2020 yılında yayılan bir derin sahte video, ABD seçimleri sırasında büyük bir kafa karışıklığına neden olmuş ve seçmenlerin yanlış bilgilendirilmesine yol açmıştır (Chesney & Citron, 2019). Bu tür teknolojiler, dezenformasyonun daha inandırıcı ve yaygın hale gelmesine katkıda bulunur.

AI'nin etik kullanımı, yapay zeka teknolojilerinin sorumlu bir şekilde yönetilmesi için kritik öneme sahiptir. Örneğin, yapay zekanın etik kullanımına yönelik oluşturulan kurallar ve rehberler, teknoloji şirketlerinin yanıltıcı içerik üretiminden kaçınmasını teşvik etmektedir. Google, etik ilkeler doğrultusunda yapay zeka projelerini denetlemekte ve bu tür teknolojilerin kötüye kullanımını önlemek için sıkı politikalar uygulamaktadır (Google AI Principles). Bu tür önlemler, yapay zeka kullanımında etik standartların korunmasına yardımcı olur.

Yapay zeka ile mücadelede yeni yaklaşımlar, dezenformasyonun tespit edilmesi ve yayılmasının önlenmesi için geliştirilmiştir. Örneğin, MIT tarafından geliştirilen bir algoritma, derin sahte videoları yüksek doğrulukla tespit edebilmektedir (Agarwal et al., 2019). Bu tür teknolojik yenilikler, yapay zeka destekli dezenformasyonla mücadelede önemli bir araçtır. Bu tür yaklaşımlar, bilgi güvenliğinin sağlanmasına ve toplumun doğru bilgilendirilmesine katkıda bulunur.

Yapay zekanın toplumsal ve etik etkileri, bu teknolojilerin sorumlu bir şekilde yönetilmesini gerektirir. Örneğin, yapay zekanın işgücü piyasasındaki etkileri, bazı mesleklerin otomasyonu nedeniyle işsizlik oranlarını artırabilir. Bu tür durumlar, sosyal adalet ve ekonomik denge açısından ciddi sonuçlar doğurabilir (Brynjolfsson & McAfee, 2014). Yapay zeka teknolojilerinin toplumsal etkilerini değerlendirmek ve bu etkileri yönetmek, sürdürülebilir bir dijital ekosistem oluşturmak için gereklidir.

Yapay zeka destekli dezenformasyonla mücadele, bilgi güvenliği ve etik değerlere uygun kullanımın sağlanması açısından büyük önem taşır. Örneğin, uluslararası iş birliği ve yasal düzenlemeler, yapay zeka teknolojilerinin kötüye kullanımını önlemek için etkili bir strateji olabilir (Floridi et al., 2018). Bu tür iş birlikleri, küresel düzeyde dezenformasyonla mücadelede önemli bir rol oynar.

Dijital dezenformasyonun önüne geçmek ve insanları bu konuda bilinçlendirerek toplumsal fayda üretmek için araştırmalarınızı ve makalelerinizi dijitaldezenformasyon.com sitesine göndererek katkıda bulunabilirsiniz. Bu platformda yayımlanan makaleler, dezenformasyonla mücadele konusunda farkındalık yaratmakta ve toplumu bilinçlendirmekte önemli bir rol oynamaktadır. Herkesin doğru bilgiye ulaşmasını sağlamak ve toplumsal istikrarı korumak için, dijital dezenformasyonla mücadelede sizin de katkılarınız büyük önem taşımaktadır. Makale yazarak bu önemli alanda topluma fayda sağlayabilir ve dezenformasyonun olumsuz etkilerini azaltmada etkin bir rol oynayabilirsiniz.

Kaynakça

- Allcott, H., & Gentzkow, M. (2017). Social Media and Fake News in the 2016 Election. Journal of Economic Perspectives, 31(2), 211-236. https://doi.org/10.1257/jep.31.2.211

Wardle, C. (2019). The Need for Smarter Fact-Checking. American Press Institute. https://www.americanpressinstitute.org/publications/reports/survey-research/fact-checking-2019/

Livingstone, S. (2018). Digital Literacy and Learning in the Context of the Digital Economy. Learning, Media and Technology, 43(3), 243-256. https://doi.org/10.1080/17439884.2018.1472601

O'Callaghan, D., Greene, D., Conway, M., Carthy, J., & Cunningham, P. (2015). Down the (White) Rabbit Hole: The Extreme Right and Online Recommender Systems. Social Science Computer Review, 33(4), 459-478. https://doi.org/10.1145/2808797.2808854

Pennycook, G., & Rand, D. G. (2020). Fighting Misinformation on Social Media Using Crowdsourced Judgments of News Source Quality. Proceedings of the National Academy of Sciences, 117(5), 2322-2328. https://doi.org/10.1073/pnas.1912444117

Chesney, R., & Citron, D. (2019). Deepfakes and the New Disinformation War: The Coming Age of Post-Truth Geopolitics. Foreign Affairs. https://www.californialawreview.org/print/deepfakes/

Google AI Principles. (n.d.). https://ai.google/principles/

Agarwal, S., Farid, H., Gu, Y., He, M., Nagano, K., & Li, H. (2019). Protecting World Leaders Against Deep Fakes. arXiv preprint. https://arxiv.org/abs/1901.08971

Brynjolfsson, E., & McAfee, A. (2014). The Second Machine Age: Work, Progress, and Prosperity in a Time of Brilliant Technologies. W. W. Norton & Company.

Floridi, L., Cowls, J., Beltrametti, M., Chatila, R., Chazerand, P., Dignum, V., ... & Schafer, B. (2018). AI4People—An Ethical Framework for a Good AI Society: Opportunities, Risks, Principles, and Recommendations. Minds and Machines, 28(4), 689-707. https://www.springer.com/gp/book/9783319464478